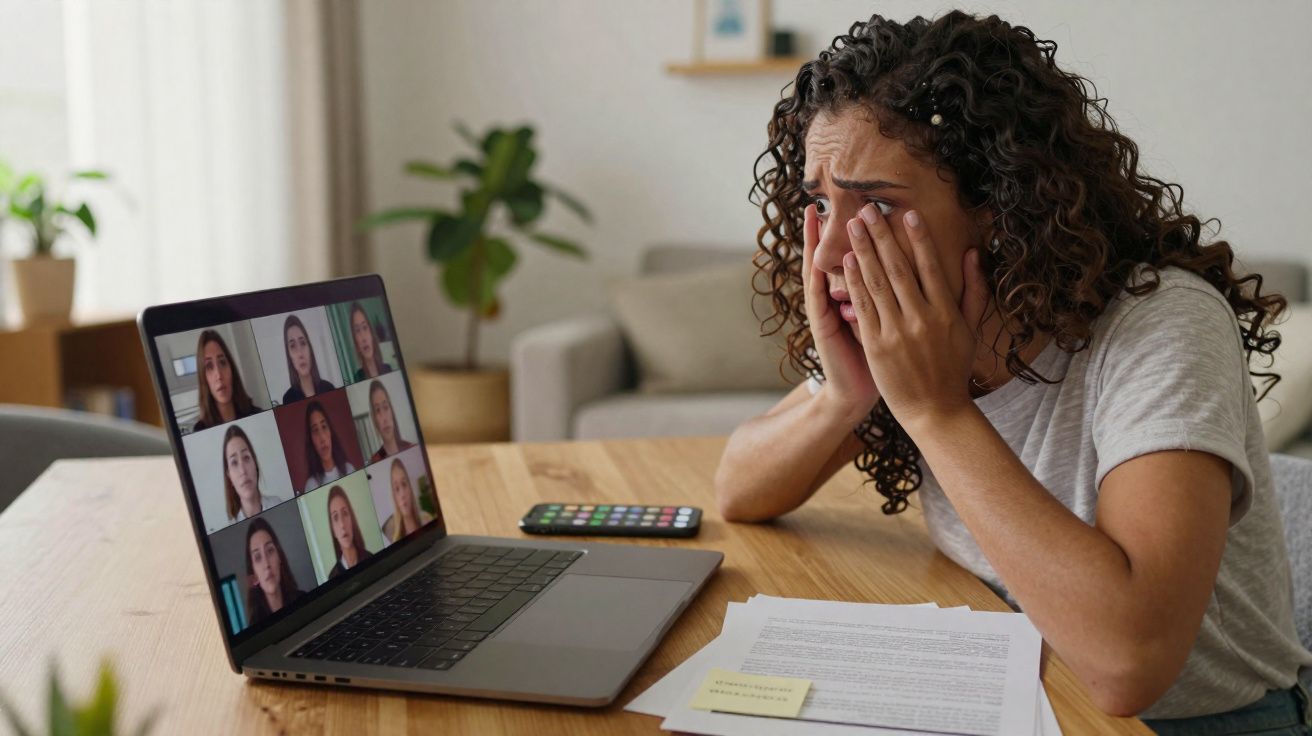

O instante em que Collien Fernandes percebe que está a circular um vídeo seu - um vídeo que ela nunca gravou - tem a textura de um pesadelo digital.

Não há cenário, nem guião, nem consentimento. Há apenas um rosto, um corpo e uma voz que parecem ser os dela a fazer coisas que não lhe pertencem. Começam a chegar mensagens com links, surgem comentários de desconhecidos sobre um suposto “escândalo”, e alguns meios de comunicação farejam o tema. De um momento para o outro, deixa de ser vista como apresentadora e actriz e passa a ser usada como ecrã de projecção para algo fabricado por uma máquina: um falso que deixa dor verdadeira.

O mais desconcertante é a facilidade com que todos nós, no dia-a-dia, passamos por estes conteúdos: deslizamos o dedo, carregamos em play, encolhemos os ombros. Só que, desta vez, a vítima é alguém reconhecida da televisão - e isso obriga-nos a olhar de frente para a dimensão do problema.

Quando um deepfake parece mais “real” do que a realidade

Quem acompanha Collien Fernandes desde os tempos da VIVA associa-a a estúdios luminosos, cultura pop e entretenimento leve. Quase ninguém espera vê-la ligada a pornografia deepfake. E é precisamente esse choque que dá força ao golpe: na internet, muitas vezes, o que pesa não é a verdade - é o clique.

O nome “Collien Fernandes” gera alcance, o rosto é familiar para muita gente e a narrativa parece “boa demais” para ser questionada. E assim o conteúdo corre: de grupos de Telegram a sites manhosos, passando por mensagens privadas que ela nunca quis receber. Hoje, o abismo está, de facto, a um clique de distância.

Há um pormenor que torna este caso particularmente inquietante: à primeira vista, o deepfake pode convencer. A expressão facial encaixa razoavelmente, a iluminação “cola”, a qualidade de imagem engana quem não está atento. Ao mesmo tempo, existe uma frieza artificial que se nota quando se observa com cuidado - só que quem é que pára para isso? Estudos nos EUA indicam que muitas pessoas vêem vídeos apenas durante alguns segundos e, ainda assim, formam uma opinião. É nesse intervalo mínimo que um abuso tecnológico se transforma num problema social: quem vê por alto acredita; quem é atacado perde.

A lei anda atrás: a zona cinzenta que protege o abuso

Do ponto de vista jurídico, os deepfakes crescem mais depressa do que a capacidade de resposta das leis. Muitos países reconhecem direitos de personalidade e mecanismos de protecção da imagem, mas, na prática, este tipo de manipulação escapa frequentemente por entre as malhas: o abuso é global, enquanto o enquadramento legal e a actuação das autoridades tendem a ser nacionais.

Para vítimas como Fernandes, isto significa uma corrida desigual. Enquanto advogados avaliam que vias existem para pressionar plataformas, identificar responsáveis ou pedir remoções, o material replica-se em cantos cada vez mais escuros da rede. É um choque directo entre a lógica da economia das plataformas - que recompensa alcance e envolvimento - e a dignidade de pessoas reais. E, demasiadas vezes, quem ganha é o algoritmo.

Um factor adicional, por vezes ignorado, é a fricção processual: pedidos de remoção podem exigir formulários, provas, validações e prazos; e, quando finalmente há resposta, o ficheiro já foi espelhado noutros domínios, re-enviado em grupos fechados ou republicado com ligeiras alterações para contornar bloqueios. A sensação de impotência não nasce apenas do conteúdo em si, mas da experiência de perseguir uma sombra que se multiplica.

O que podemos fazer (e o que já não dá para “desfazer”)

Não existe um botão mágico para apagar todos os falsos. Ainda assim, há passos concretos que transformam a raiva impotente em reacção organizada. Quem tem exposição pública - e hoje isso inclui influenciadores com alguns milhares de seguidores - beneficia de um plano de emergência digital:

- Guardar prova: capturas de ecrã, links, datas e horas, de forma sistemática e sem dramatização.

- Registar a disseminação: onde apareceu (Telegram, sites, redes sociais), quem partilhou e em que contexto.

- Activar apoio especializado: advogados com experiência em media/tecnologia e entidades de apoio a vítimas.

- Dizer de forma clara: “Não sou eu”: o silêncio é frequentemente distorcido por trolls como “confissão”. Num feed caótico, a transparência pode ser a única moeda estável.

Para quem não é figura pública, a injustiça pode parecer ainda maior. Quem acredita numa estudante desconhecida, num auxiliar de saúde ou numa professora quando surgem imagens falsas e sexualizadas? Muitas vítimas sentem vergonha, apesar de não terem feito nada de errado. Aqui está o núcleo emocional do tema: os deepfakes não atacam apenas a imagem pública - corroem a auto-percepção e a segurança íntima.

Todos conhecemos aquele sobressalto quando reaparece uma fotografia embaraçosa do passado e pensamos: “Meu Deus, toda a gente vai ver isto.” Agora imagina que a imagem é pornográfica - e tecnicamente muito convincente. Sejamos honestos: ninguém está emocionalmente preparado para isso.

Para que o cenário mude, são necessários três pilares: coragem para quebrar o silêncio, solidariedade colectiva e limites claros sobre aquilo que escolhemos ver e partilhar. Quando Collien Fernandes afirma “não sou eu, fui alvo de abuso”, não é apenas um desabafo de celebridade - é um sinal para quem não tem palco.

“Não são só imagens ou vídeos que estão a ser manipulados. São biografias, carreiras e relações. No fim, há sempre uma pessoa real, com uma história real, presa a tudo isto.”

- Não reencaminhar: nem “só para ver”, nem por curiosidade, nem em grupos privados.

- Preservar evidência: links, capturas, datas e horas - com calma, mas com consistência.

- Procurar aliados: amigos, colegas, entidades de apoio - ninguém deveria tentar enfrentar sozinho uma rede inteira.

Um passo extra: como agir nas plataformas de forma eficaz

Além de denunciar, ajuda ser estratégico. Sempre que possível, use as opções específicas de denúncia por conteúdo íntimo não consentido e suplantação de identidade (quando existirem), porque estas categorias costumam ter prioridade. Em paralelo, vale a pena solicitar cópia do registo da denúncia (número de caso) e guardar confirmações por e-mail ou captura de ecrã. Se a plataforma permitir, peça também a remoção de reuploads e versões recortadas - muitos abusadores tentam “fugir” alterando apenas alguns segundos do vídeo.

O caso Collien Fernandes e Deepfakes: o que isto diz sobre todos nós

O que aconteceu com Collien Fernandes não é um episódio bizarro e isolado; é um teste de stress à nossa moral digital. Quão depressa desviamos o olhar quando uma mulher é colocada no centro de um turbilhão tóxico? Com que facilidade encolhemos os ombros e dizemos “é a internet”? A verdade é que este tema revela o quanto levamos a sério - ou não - o direito à autodeterminação no espaço digital.

Consumimos rostos como se fossem conteúdo e esquecemo-nos de que, por trás de cada rosto, existe uma pessoa que leva isto para casa: para a cozinha, para o quarto, para o espelho.

Do lado técnico, os deepfakes estão a melhorar a grande velocidade. Ferramentas de IA que hoje ainda falham podem tornar-se quase imperceptíveis dentro de poucos anos. A pergunta decisiva não é apenas “até onde vai a tecnologia?”, mas sim: crescemos por dentro ao ritmo dela, ou limitamo-nos a correr atrás? A responsabilidade pode começar num ponto pequeno e banal: o segundo entre carregar em play e seguir em frente. O reflexo de denunciar em vez de gozar. A decisão silenciosa de não acreditar em tudo só porque aparece em ecrã inteiro.

Collien Fernandes escolheu não ficar calada. Isso é desconfortável e, por vezes, arriscado: quem reage pode tornar-se alvo de mais ataques. Mas a mesma exposição que a torna vulnerável também dá palavras a quem não as tem. Talvez seja esse o avanço discreto desta história: os deepfakes obrigam-nos a renegociar a forma como pensamos dignidade, verdade e esfera pública - e a colocar a protecção de pessoas reais acima do fascínio pela técnica.

Síntese em tabela

| Ponto-chave | Detalhe | Valor para o leitor |

|---|---|---|

| Deepfakes como ataque pessoal | O caso Collien Fernandes mostra quão rapidamente conteúdos manipulados podem danificar carreiras e vida privada | Compreender por que “é só um vídeo” pode ter consequências graves fora do ecrã |

| Reagir em vez de paralisar | Documentação, passos legais, esclarecimento público e redes de apoio como resposta | Ideias práticas do que fazer num caso real - consigo ou com alguém próximo |

| Ética do clique | Uso consciente do que vemos, acreditamos e reencaminhamos | Sensação de controlo: cada clique tem peso e pode amplificar ou travar o abuso |

FAQ

Pergunta 1 - O que é exactamente um deepfake no contexto do caso Collien Fernandes?

Um deepfake é imagem ou vídeo manipulado com IA, em que o rosto e/ou o corpo de uma pessoa real é inserido noutra cena. No caso de Collien Fernandes, trata-se de conteúdos pornográficos nos quais o rosto dela foi tecnicamente montado sem qualquer participação ou consentimento.Pergunta 2 - Como posso identificar um deepfake se não sou especialista?

Não é infalível, mas há sinais: expressão facial ligeiramente artificial, transições pouco limpas junto ao pescoço, sombras incoerentes, luz que não “bate certo” e olhos com rigidez estranha. O contexto também denuncia: “vídeos de escândalo” repentinos, sem fonte credível, são suspeitos.Pergunta 3 - O que devo fazer se eu próprio(a) for vítima de um deepfake?

Guarde provas (links, datas, horas, capturas), evite decisões precipitadas, contacte advogados com experiência em media/tecnologia e procure entidades de apoio. Em paralelo, informe pessoas de confiança e, se for viável, faça uma declaração clara a distanciar-se do conteúdo.Pergunta 4 - Partilhar um deepfake pode ser crime?

Depende do país e do conteúdo. Em material sexualizado, a disseminação pode constituir violação de direitos de personalidade e ter consequências legais. Mesmo quando não encaixa de forma directa num crime específico, continua a ser uma violação ética grave.Pergunta 5 - Como me posso proteger preventivamente?

Não existe protecção a 100%. Ajuda reduzir a exposição de imagens e vídeos, reforçar definições de privacidade e ter cuidado acrescido com conteúdos íntimos. Ainda assim, o mais determinante é criar uma cultura em que estes falsos são socialmente condenados - e não alimentados por cliques e partilhas.

Comentários

Ainda não há comentários. Seja o primeiro!

Deixar um comentário