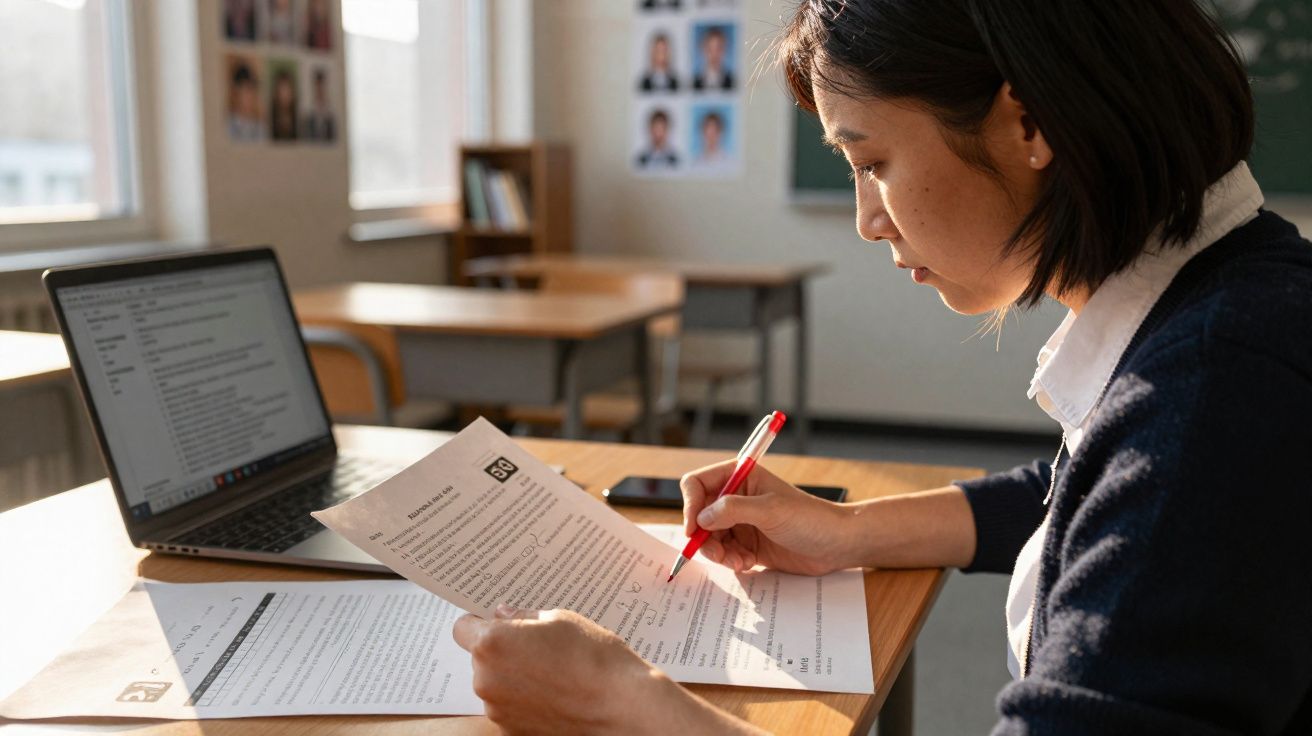

Um ensaio cronometrado de A-level de Literatura Inglesa, escrito à mão com tinta azul… só que o aluno que o “redigiu” nunca pegou numa caneta para o pensar. As frases vieram do ChatGPT e foram copiadas com letra certinha para papel pautado, com a margem a vermelho, como qualquer prova.

Do outro lado da secretária, a professora ajusta os óculos, solta um suspiro e começa a ler. Ao início, a caneta dela hesita no ar. Depois avança: vistos e cruzes vermelhos vão aparecendo nas margens. Ela franze o sobrolho. Sublinha uma frase que soa fluida, mas estranhamente vazia. Levanta os olhos e diz, quase em sussurro:

“Isto não soa a nenhum jovem de 17 anos a quem eu dê aulas.”

Quinze minutos mais tarde, escreve um número no topo: uma nota em 20 que, sem dramatismos, diz muito sobre o lugar da IA na sala real de exame.

“Parece um manual, não um adolescente”: o que a professora detecta num texto do ChatGPT

A professora, Sarah, corrige ensaios de A-level há mais de dez anos. Conta que, regra geral, bastam-lhe poucos parágrafos para perceber se uma prova está a desenrascar-se, em pânico ou a voar alto. Aqui, o motivo da pausa é outro.

“Está polido de uma forma estranha”, comenta. “Mas onde está a voz?” O texto cumpre os requisitos mais óbvios: refere o autor, inclui citações, identifica algumas técnicas. As frases vêm alinhadas. A gramática está limpa. À primeira vista, parece o tipo de resposta que os painéis de exame (exam boards) apreciam.

Só que, à medida que avança, a caneta vermelha volta sempre ao mesmo tipo de observações: “vago”, “generalista”, “não está ancorado no excerto”. A IA produziu um ensaio aceitável. Não produziu um ensaio humano.

O desafio era simples: uma pergunta ao estilo A-level sobre um excerto de um romance do século XX. O aluno, curioso e um pouco ansioso com as notas, colocou a pergunta no ChatGPT e copiou a resposta palavra por palavra. Sem ajustar. Sem acrescentar ideias. Foi um teste direto: até que ponto um ensaio de IA aguenta um esquema de classificação real?

Na folha, o texto soa seguro. Fala de “perspetiva narrativa”, “tensão emocional”, “envolvimento do leitor” - o tipo de termos que os alunos ouvem repetidamente durante o ano. Mas, quando Sarah cruza a resposta com os critérios oficiais, algo não bate certo.

O ensaio aponta técnicas sem mostrar, com precisão, como funcionam. Nomeia emoções sem localizar onde aparecem no texto. Invoca “o leitor” de forma ampla e uniforme, como se toda a gente reagisse da mesma maneira. Num A-level, em que a análise fina é recompensada, essa fluidez transforma-se numa desvantagem.

“Se isto fosse um ensaio inicial do 12.º ano”, diz ela, “eu até ficava satisfeita. Para os exames finais de A-level… está claramente no meio.” Não é um desastre. Também não é brilhante. É seguro, mas um pouco oco. A nota que escreve - 11 em 20 - cai com um peso seco e definitivo.

Entre soar inteligente e ganhar pontos: o choque entre a IA e os critérios de avaliação

Depois de assentar a nota, começa a parte verdadeiramente reveladora. Sarah percorre o texto linha a linha e confronta-o com os objetivos de avaliação oficiais. É aqui que a voz educada e genérica do ChatGPT embate na geometria fria do que, de facto, dá pontos num exame.

A primeira falha é a falta de especificidade. O ensaio fala sobre o texto, mas raramente entra dentro dele. Em vez de ampliar uma expressão, uma escolha verbal, uma viragem estrutural, mantém-se acima da página como uma filmagem aérea: visão bonita, prova fraca. Em termos de A-level, isso empurra-o para fora dos escalões altos e coloca-o na zona do “podia ser sobre qualquer livro”.

A segunda fraqueza é o argumento. A IA oferece respostas equilibradas e quase dolorosamente neutras. Não há risco, não há posição, não há hipótese orientadora. Repete fórmulas do tipo “isto sugere” e “isto pode indicar”, mas evita comprometer-se com uma linha de pensamento clara. Para um corretor, isso soa a algo pouco desenvolvido, mesmo quando o vocabulário parece adulto.

Por fim, o ensaio tem um ar estranhamente intemporal. Quase não mostra consciência de contexto: do mundo do autor, do período, das tensões sociais ou culturais que moldam a escrita. É como ouvir alguém falar de um romance num vácuo. Num esquema de classificação que valoriza ligações e enquadramento, essa falta de ancoragem custa caro. O texto não está “errado”. Está meio acordado.

Como alguns professores começam a usar a IA (e o ChatGPT) sem se deixarem enganar

Terminada a correção, Sarah não deita fora a prova. Guarda-a. Quer mostrá-la aos alunos como estudo de caso - não como ameaça, mas como espelho: eis o que acontece quando um ensaio soa bem e, ainda assim, pensa pouco.

A abordagem dela é quase cirúrgica. Projeta um parágrafo no quadro e pergunta à turma: “Onde está, exatamente, a citação? Onde está o detalhe? Onde é que o painel de exame vai reconhecer que vocês conhecem o texto, e não apenas a teoria?” A sala fica em silêncio. De repente, as frases suaves da IA parecem frágeis sob a luz direta.

Depois faz algo inesperado: pede aos alunos que “consertem” o texto do ChatGPT. Acrescentem uma citação aqui. Troquem uma expressão vaga por um pormenor concreto. Transformem uma ideia solta num argumento claro. Em dez minutos, o ensaio torna-se mais forte e mais humano - e os alunos voltam a sentir a própria inteligência no centro do processo.

Ela não é ingénua. Sabe que muitos adolescentes vão usar IA para encurtar trabalhos de casa. Numa terça-feira cansativa, com três prazos a cair em cima e a cabeça a ferver, é tentador. No ecrã, aqueles parágrafos prontos parecem uma boia. Sarah enfrenta isso de frente:

“Se usarem o ChatGPT como muleta, acabam com um 11 em 20”, diz-lhes. “Seguro. Liso. Esquecível. O painel de exame recompensa pensamento - não recompensa soar à Wikipédia com boas maneiras.” O tom é firme, não acusatório. Ela sabe que, sob a pressão das notas, os alunos agarram-se ao que lhes promete certezas.

Também vê a ansiedade por baixo da tecnologia. Nem sempre é preguiça; muitas vezes é medo: medo de escrever “a coisa errada”, de não soar suficientemente inteligente, de não ser “bom a Português/inglês”. Por isso tenta transformar a IA de atalho secreto em ferramenta visível - algo que se desmonta, critica e melhora, em vez de se venerar ou temer.

“Os examinadores não querem um robô”, diz Sarah. “Querem provas de que uma mente real mastigou um texto real.”

Na prática, isso significa ensinar a usar a IA como gerador de rascunhos, e não como escritor fantasma: pedir um plano, uma lista de ângulos possíveis, um banco de vocabulário - e depois fechar a ferramenta e escrever o ensaio com erros próprios e rasgos de insight. É aí que moram os pontos.

- Use a IA para fazer brainstorming, não para copiar: deixe-a desbloquear ideias e reescreva tudo com palavras suas.

- Interrogue cada frase: onde está a prova no texto, nos dados ou no estudo de caso?

- Treine a sua voz com regularidade: parágrafos curtos e imperfeitos, não apenas versões finais muito polidas.

Dois hábitos extra que elevam a nota (e que a IA raramente faz por si)

Uma boa estratégia é criar uma rotina de “prova rápida”: antes de entregar um ensaio, sublinhe cada afirmação interpretativa e, ao lado, escreva a evidência concreta (uma citação curta e a técnica exata). Se não conseguir ligar afirmação e prova, o corretor também não conseguirá.

Outra prática útil é preparar um pequeno “mapa de contexto” por obra (autor, época, temas dominantes e 2–3 ligações relevantes ao excerto). Não é despejar informação histórica: é usar contexto para afinar a leitura. Isto melhora imediatamente a qualidade do argumento e torna muito mais difícil que um texto pareça genérico.

O que isto significa para alunos, professores e a futura sala de exame com IA

Num nível, a história é simples: o ChatGPT escreveu um ensaio de A-level e recebeu 11/20. Não reprova, não faz milagre - é uma prova média que qualquer aluno humano competente consegue superar num bom dia. Noutro nível, esta nota revela uma mudança silenciosa que já está a acontecer em muitas salas de aula.

Os professores deixaram de ensinar apenas conteúdo; agora ensinam também como ser visivelmente humano no papel: como mostrar um raciocínio rastreável, como revelar hesitações e saltos de pensamento, como provar ao examinador que existe um cérebro vivo por trás de cada parágrafo. A IA imita a superfície desse processo. Sustentar a profundidade, durante muito tempo, é outra coisa.

Entretanto, os alunos já experimentam em todo o lado: no comboio cheio, à mesa apertada da cozinha, entre explicações e atividades. Alguns assumem. Outros escondem. Vivemos um intervalo estranho em que as regras parecem difusas: a tecnologia corre mais depressa do que as políticas, os encarregados de educação murmuram sobre “batota” e “justiça” e, ao mesmo tempo, perguntam-se em silêncio se usariam ferramentas idênticas no trabalho. No fundo, toda a gente sente que a fronteira entre ajuda e substituição está a ficar mais turva.

O 11/20 a vermelho não resolve essa tensão. Faz algo mais subtil: mostra que o sistema, com todas as falhas, ainda reconhece esperteza vazia. Palavras suaves sem pensamento afiado continuam a soar errado a um corretor experiente. Pelo menos por agora, numa prova escrita em condições de exame, a compreensão genuína é difícil de falsificar ao longo de duas páginas.

| Ponto-chave | Detalhe | Interesse para o leitor |

|---|---|---|

| A IA consegue uma nota “média”, não “extraordinária” | O ensaio do ChatGPT obteve 11/20: claro, mas genérico e superficial | Alivia a pressão de “competir com máquinas” e mostra onde os humanos ainda ganham |

| A especificidade vale mais do que a fluidez | Os examinadores recompensam análise precisa, citações e argumento claro - não sofisticação vaga | Dá aos alunos uma forma concreta de melhorar notas de imediato |

| A IA pode ser ferramenta, não armadilha | Usada para ideias e planificação e depois reescrita, a IA pode integrar a aprendizagem | Ajuda a usar IA de forma ética sem sabotar competências |

Perguntas frequentes

- O ChatGPT consegue mesmo passar um exame de A-level?

Sozinho, tende a ficar nos escalões intermédios: tem estrutura suficiente para passar, mas é demasiado vago e genérico para atingir notas altas com esquemas de classificação reais.- Os painéis de exame detetam um texto escrito por IA?

Em exames presenciais e manuscritos, as ferramentas automáticas pouco ajudam; os corretores experientes apoiam-se na voz, na precisão e em erros plausíveis de aluno.- Usar ChatGPT nos trabalhos de casa é considerado batota?

Depende das regras da escola, mas copiar respostas completas costuma ser tratado como plágio, mesmo que as palavras venham de um robô.- Como usar IA sem prejudicar a aprendizagem?

Use-a para gerar ideias, estruturar planos ou rever conceitos e depois feche a ferramenta e escreva a sua versão a partir da memória e da compreensão.- Os exames vão mudar por causa da IA?

Muitos professores esperam mais escrita em sala, avaliações orais e tarefas com reflexão pessoal, o que dificulta depender totalmente de texto gerado.

Comentários

Ainda não há comentários. Seja o primeiro!

Deixar um comentário