Antes das fachadas de vidro passam alunos, copo de café na mão e auscultadores nos ouvidos - enquanto, lá dentro, juristas, peritos em informática forense e polícias param vídeos, rebobinam, desdobram-nos em fotogramas. Num ecrã, um político regional sorri para a câmara e profere uma frase que nunca disse. O movimento dos lábios encaixa, a voz soa familiar, a luz parece natural. E, ainda assim, cada detalhe é falso.

Todos reconhecemos aquele instante ao fim do dia em que se faz scroll nas redes sociais quase em piloto automático, com atenção a meio gás. É precisamente aí que os deepfakes acertam em cheio. No estado alemão de Hessen, perceberam que esperar até que uma brincadeira se transforme num incêndio generalizado é um luxo que já não existe. O ambiente nas autoridades de segurança lembra mais a preparação para cheias do que uma conferência digital descontraída. E enquanto, a nível federal e europeu, ainda se afinam formulações e enquadramentos, em Hessen sucedem-se discretamente projectos-piloto. O que se testa em Wiesbaden, longe dos holofotes, pode vir a influenciar quanto continuaremos - ou não - a acreditar em imagens.

Hessen corta a tempo: travar os deepfakes antes de a rede arder

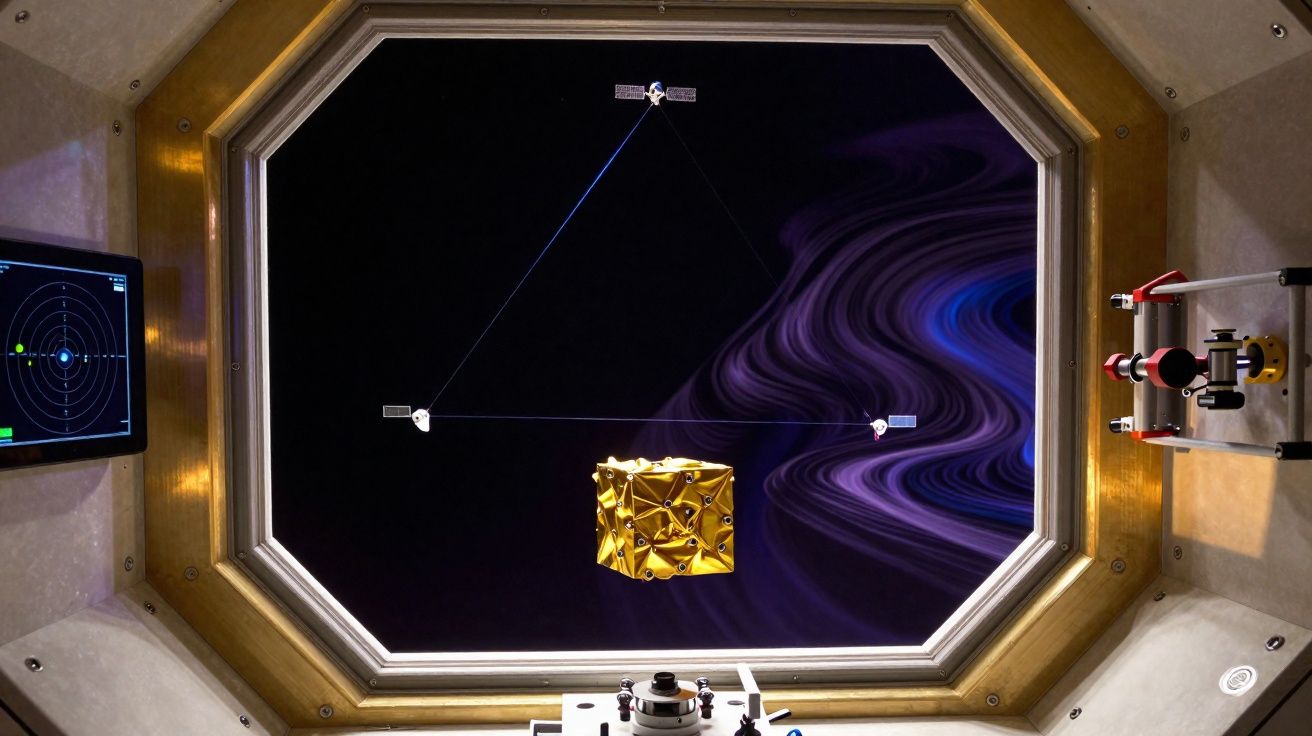

No centro de situação do Landeskriminalamt (LKA) de Hessen, uma carta da Alemanha ocupa a parede. Pequenos pontos vermelhos acendem sempre que alguém sinaliza um vídeo suspeito: um grupo de conversa, um canal no Telegram, um clip viral no TikTok. À primeira vista, nada de extraordinário - até se perceber a sofisticação com que os algoritmos já “mentem”. A equipa especializada em deepfakes trabalha nisto desde muito antes de o termo ter entrado no vocabulário do dia-a-dia: decompõem vídeos em fluxos de dados, procuram micro-imperfeições, sombras quase invisíveis, contornos de pixel que traem a montagem.

Quem fala com estes profissionais não encontra alarmismo; encontra pragmatismo. O receio que se sente é mais silencioso: o medo de uma erosão lenta da confiança. Um investigador resume o problema com frieza: “Se, durante uma campanha eleitoral, surgir um vídeo-escândalo falsificado com perfeição, podemos não ter nem 24 horas antes de o ambiente virar.”

Um caso que não desapareceu dos corredores

Um episódio do ano passado ainda pesa na memória interna. Numa cidade de médio porte no centro de Hessen, apareceu de repente um vídeo em que uma directora de escola alegadamente fazia comentários racistas. A gravação parecia um vídeo clandestino de telemóvel: imagem ligeiramente tremida, acústica típica de cantina, aquele realismo banal que convence. Em poucas horas, o conteúdo circulou em grupos de pais, alunos apelaram a protestos e páginas locais no Facebook entraram em ebulição.

Foi a informática forense do LKA que desmontou a história: a voz tinha sido sintetizada e o rosto tinha sido sobreposto a outro vídeo. Os peritos conseguiram reconstituir de que software viera a falsificação, que erros de renderização se escondiam no fundo e até que a fonte de luz não batia certo, do ponto de vista físico, com a sala retratada. A directora levou semanas a recuperar a reputação. Os autores acabaram por ser identificados num fórum ligado a videojogos - meio adolescentes, meio “hackers” de passatempo - que queriam “apenas ver se dava”.

Sejamos realistas: quase ninguém, perante um vídeo carregado de emoção, vai verificar cinco fontes antes de o reenviar ao melhor amigo.

O que Hessen está a fazer, na prática, contra deepfakes (e porque importa)

A resposta de Hessen assenta no que o Ministério do Interior do estado chama de “antecipação operacional”: a ideia de que esperar que o direito penal entre em acção é, muitas vezes, chegar tarde. Por isso, várias frentes avançam em paralelo.

- Unidades especializadas no LKA, focadas em detecção e atribuição técnica (de onde vem, como foi fabricado, que “impressões digitais” deixa).

- Formação para esquadras e equipas de investigação, para que os sinais de manipulação não passem despercebidos logo no primeiro contacto.

- Cooperação com universidades, incluindo Darmstadt e Frankfurt, onde se desenvolvem ferramentas de detecção e métodos de validação.

- Testes com sistemas de IA capazes de analisar, em tempo real, fluxos de redes sociais à procura de anomalias - não para vigiar opiniões, mas para identificar padrões em imagens e vozes que sugerem manipulação.

Em simultâneo, Hessen está a mapear zonas cinzentas jurídicas. Quando é que um deepfake pode ser entendido como ofensa à integridade? Quando entra em terreno de incitamento ao ódio? Quando não passa de uma “partida” estúpida? Um jurista no ministério descreve o paradoxo assim: “Em certos momentos, estamos a escrever comentários para leis que ainda nem existem.” A realidade, dita sem dramatismo, é esta: o avanço técnico de quem falsifica costuma estar a poucos cliques de distância do legislador - e o objectivo é reduzir esse fosso.

Uma cadeia “anti-deepfake” nos bastidores

Nos bastidores, foi montada uma espécie de cadeia de resposta.

- Canais de sinalização: cidadãos, autarquias e órgãos de comunicação podem encaminhar conteúdos suspeitos para pontos de contacto especializados, em parte através de portais online protegidos.

- Triagem forense: ferramentas analisam falhas de imagem, “glitches” de áudio e artefactos típicos de IA.

- Treino e calibração: estes sistemas são afinados com equipas de investigação, incluindo projectos com a TU Darmstadt, onde há trabalho de longa data em segurança informática e detecção de falsificações.

- Capacitação do sistema judicial e mediático: há formação em escolas da polícia e actualização para procuradores, para enquadrar deepfakes como prova - e, quando necessário, questioná-los de forma tecnicamente fundamentada.

- Coordenação com plataformas: o ministério trabalha em acordos e canais de contacto para que clips particularmente perigosos possam ser rapidamente bloqueados, limitados ou assinalados.

Não é um sistema perfeito - mas já é um início operacional e verificável, e isso faz diferença quando cada hora conta.

Um ponto que raramente é dito: o impacto não é só político

Além de eleições e campanhas, há um efeito colateral menos visível: extorsão e fraude por voz. Com clones de voz cada vez mais convincentes, crescem os cenários em que um “director” pede uma transferência urgente, ou em que alguém imita um familiar para solicitar dinheiro. Esta vertente mistura cibercrime com manipulação psicológica - e obriga organizações (escolas, autarquias, empresas) a criarem rotinas internas de confirmação, como palavras-passe combinadas ou chamadas de retorno por canais alternativos.

E há ainda um risco social difícil de medir: quando as pessoas passam a acreditar que “tudo pode ser falso”, abre-se espaço para o inverso - negar evidências reais com a desculpa do deepfake. Por isso, a estratégia não pode ser apenas desmentir; tem de preservar procedimentos de prova e confiança pública.

A parte mais difícil: pessoas, vergonha e reacções em cadeia

Em conversas repetidas, surge sempre a mesma ideia: a tecnologia é complexa, mas o factor humano é, muitas vezes, mais duro. Muita gente sente vergonha por ter caído num falso. Em grupos de WhatsApp de pais, por exemplo, prefere-se o silêncio a admitir: “Reencaminhei sem pensar.” O mesmo acontece com políticos locais ou dirigentes associativos cujo nome fica manchado por áudios forjados. O impulso inicial tende a ser recuar - não apresentar queixa.

Hessen tenta contrariar este padrão com sensibilização que não soa a sermão. Agentes vão às escolas explicar quão simples se tornou clonar uma voz e reforçam uma mensagem desconfortável, mas útil: ninguém é “inteligente demais” para nunca ser enganado. Em workshops para administrações locais, treina-se também a resposta comunicacional quando surge um vídeo manipulado: calma, transparência, declarações claras e factos rapidamente verificáveis - sem pânico e sem o clássico “sem comentários”. E, sim, também o jornalismo tem de reaprender a parar um segundo quando aparece um “leak” demasiado perfeito.

Um responsável do Ministério do Interior resume a filosofia de forma seca:

“Não vamos impedir todos os deepfakes. Mas podemos fazer com que, em Hessen, seja mais difícil influenciar eleições ou destruir vidas com isto.”

Desta abordagem nasceu uma lista informal que circula por serviços públicos e redacções:

- De onde vem, afinal, o vídeo ou a gravação - existe uma origem clara e rastreável?

- Há testemunhas independentes que confirmem a situação sem dependerem do próprio vídeo?

- O comportamento da pessoa no clip é anormalmente extremo face ao seu padrão habitual?

- Notam-se detalhes suspeitos: pestanejar estranho, sombras incoerentes, bordos desfocados à volta do rosto?

- O momento da publicação é oportunista - por exemplo, imediatamente antes de uma eleição, de um julgamento ou de uma decisão relevante?

Muitos pontos parecem básicos, quase “à antiga”. Ainda assim, no quotidiano são saltados porque tudo tem de ser imediato. No centro da estratégia está algo surpreendentemente simples: higiene digital. A tecnologia, por trás, é altamente sofisticada; a aplicação prática tem de ser pé no chão.

O que acontece quando deixamos de confiar nas imagens - e porque não tem de ser só medo

Um dia dentro do aparelho de segurança de Hessen deixa um duplo sentimento. Por um lado, um aperto: hoje é possível gerar, em minutos, um clip convincente em que qualquer pessoa aparentemente diz ou faz qualquer coisa. Ninguém é “irrelevante demais” para não ser alvo - basta um conflito escolar ou uma relação que terminou mal. Por outro, a construção de contra-medidas é surpreendentemente sóbria: sem histeria, mais próxima de rotinas de protecção civil do que de narrativas de fim do mundo.

Enquanto em Berlim se discute legislação, programas de literacia mediática e grandes regulamentos para IA, em Hessen procura-se estabilizar o dia-a-dia - da sala de aula à chancelaria do estado. Não é um salvador da internet; é um laboratório real. Aceitam-se erros, ajustam-se métodos, testam-se cooperações. Este “começar já” contrasta com a tendência, tão comum, de só agir quando tudo está fechado a 100%.

Para quem usa redes sociais, isto implica habituar-se a uma rotina mental nova: diante de um vídeo espectacular, activar uma pergunta interna de controlo. Parece cansativo, mas pode ser libertador - menos reflexo, mais reflexão; menos piloto automático da indignação, mais uma pausa curta para pensar: “Quem beneficia se eu acreditar nisto agora?”

Hessen mostra que o Estado não tem de ser impotente perante manipulações por IA. Pode criar estruturas, atribuir responsabilidades, concentrar recursos - e dizer publicamente: levamos isto a sério, vamos experimentar, mesmo sem perfeição. No fim, a confiança online não regressa apenas com proibições; volta com a combinação de técnica, direito e um novo hábito de dúvida saudável. Talvez, daqui a alguns anos, se olhe para estes primeiros projectos anti-deepfake e se reconheça: foi aí que começámos a reaprender a confiar em imagens digitais - com consciência, não às cegas, mas também sem paralisia.

| Ponto central | Detalhe | Valor para o leitor |

|---|---|---|

| Hessen cria estruturas especializadas contra deepfakes | Equipas do LKA, cooperação com a TU Darmstadt, portais de sinalização de conteúdos suspeitos | Mostra, de forma concreta, como um estado pode reagir operacionalmente a uma ameaça emergente |

| As pessoas são emocionalmente vulneráveis a deepfakes | Exemplos em escolas, política local e redes sociais; vergonha por “cair” num falso | Aumenta a consciência sobre a própria vulnerabilidade e reduz o estigma de admitir o erro |

| Rotinas de verificação em vez de pânico | Checklist simples para o dia-a-dia; foco em higiene digital em vez de perfeição | Orientação prática, imediatamente aplicável, para reagir com calma e espírito crítico |

Perguntas frequentes (FAQ)

Como é que uma pessoa comum pode reconhecer um deepfake?

Não existe uma regra única e infalível. Normalmente funciona melhor juntar vários indícios: pestanejar pouco natural, dentes “estranhos”, sombras incoerentes, bordos do rosto com aspecto “cosido” ou áudio que não casa com o ambiente. Se o conteúdo é altamente emocional e parece encaixar “na perfeição” numa polémica política, vale a pena confirmar com mais calma.O que está Hessen a fazer, exactamente, contra deepfakes?

O estado aposta em equipas de investigação especializadas, informática forense, parcerias com centros de investigação, formação para polícia, justiça e administração pública, canais de sinalização de conteúdos e contactos com plataformas para encurtar tempos de resposta.Os deepfakes já são crime na Alemanha?

Não existe um “artigo dos deepfakes” específico. Ainda assim, muitas falsificações encaixam em crimes já previstos, como difamação, injúria agravada, incitamento ao ódio, coacção ou violações de direitos de personalidade. Em Hessen, trabalha-se activamente na aplicação destas normas a casos novos.Qualquer pessoa pode ser afectada por um deepfake?

Sim. Antes, o alvo típico eram figuras públicas; hoje, bastam conflitos privados ou disputas em contexto escolar para alguém montar imagens ou clips manipulados. Aplicações baratas e modelos de IA acessíveis reduziram drasticamente a barreira de entrada.O que posso fazer, pessoalmente, para me proteger?

Partilhar menos dados pessoais, sobretudo gravações longas de voz e vídeos privados; não reenviar de imediato conteúdos indignantes; procurar fontes credíveis para temas sensíveis; e, quando possível, confirmar directamente com os envolvidos. E se cair num falso, é preferível assumir e corrigir do que ficar calado e continuar a espalhar.

Comentários

Ainda não há comentários. Seja o primeiro!

Deixar um comentário